IT 之家 12 月 9 日音讯,苹果公司因在 2022 年取消原定的儿童性无情材料(CSAM)检测缱绻而被告状。一位童年时辰曾遇到性无情的 27 岁女性以假名告状苹果欧洲杯体育,指控其抵牾了保护受害者的容或。

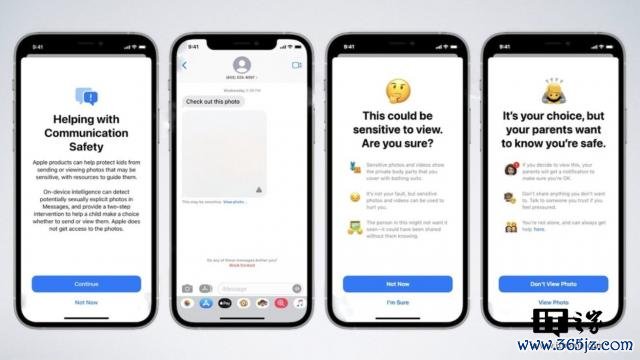

苹果在 2021 年末曾文书缱绻通过建筑端哈希值系统扫描 iCloud 中的图片,以检测和糟蹋 CSAM 传播,并在用户发送或经受含透露实质的照转眼发出告诫。当今,透露实质检测功能(Communication Safety)仍然存在,但 CSAM 检测功能因阴私众人、儿童安全组织和政府的粗抗争对被取消。

告状者称,她在 CSAM 检测功能仍在时,曾接到功令部门的见知,发现她遇到性无情的图片通过一台在佛蒙特州查获的 MacBook 被上传至了 iCloud。她在诉讼中暗示,苹果罢手这一功能的决定使这些材料得以粗造传播,苹果因此向糜费者销售了"有劣势的居品",对像她这么的用户群体形成了伤害。

据该女子的又名讼师称,原告要求苹果调动其作念法,并向可能多达 2680 名其他适合要求的受害者提供补偿,此类受害者有权凭证法律得到至少每东说念主 15 万好意思元的补偿。要是一起受害者班师得到补偿,苹果的补偿金额可能跳动 12 亿好意思元(IT 之家备注:现时约 87.28 亿元东说念主民币)。

访佛的案件已在北卡罗来纳州发生。又名 9 岁的 CSAM 受害者指控苹果,称她通过 iCloud 阿谀收到生分东说念主发送的作歹视频,并被饱读吹拍摄并上传访佛实质。苹果公司忽视了一项驳回案件的动议,指出联邦法例第 230 条保护其免于对用户上传到 iCloud 的材料承担包袱。但近期法院裁定,这一法律保护仅适用于积极实质审核的情形,可能减弱苹果的抗辩根由。

针对新诉讼,苹果发言东说念主弗雷德・塞恩兹暗示:"苹果合计儿童性无情材料令东说念主发指,咱们致力于于在不损伤用户阴私和安全的前提下积极打击干系罪人。"他提到苹果膨胀了信息期骗中的透露实质检测功能,并允许用户举报无益材料。然而,原告罕见讼师玛格丽特・马比合计,苹果的设施远远不够。

马比暗示欧洲杯体育,她通过功令论述和干系文献发现了跳动 80 起与受害者图像及苹果居品干系的案例,其中一个共享这些图像的东说念主是又名湾区须眉,其 iCloud 账户中存储了跳动 2,000 张作歹图片和视频。